建大新闻网讯 近日,管理学院张新生教授智能管理与决策团队在人工智能协同社会治理方面取得重要进展。以“Linguistic features of AI mis/disinformation and the detection limits of LLMs(AI错误/虚假信息的语言特征及大型语言模型的检测局限)”为题,发表在Nature子刊Nature Communications上(影响因子15.7,中科院一区Top期刊)。张新生教授为论文通讯作者,我校博士研究生马玉龙为论文第一作者,我校为论文第一完成单位。

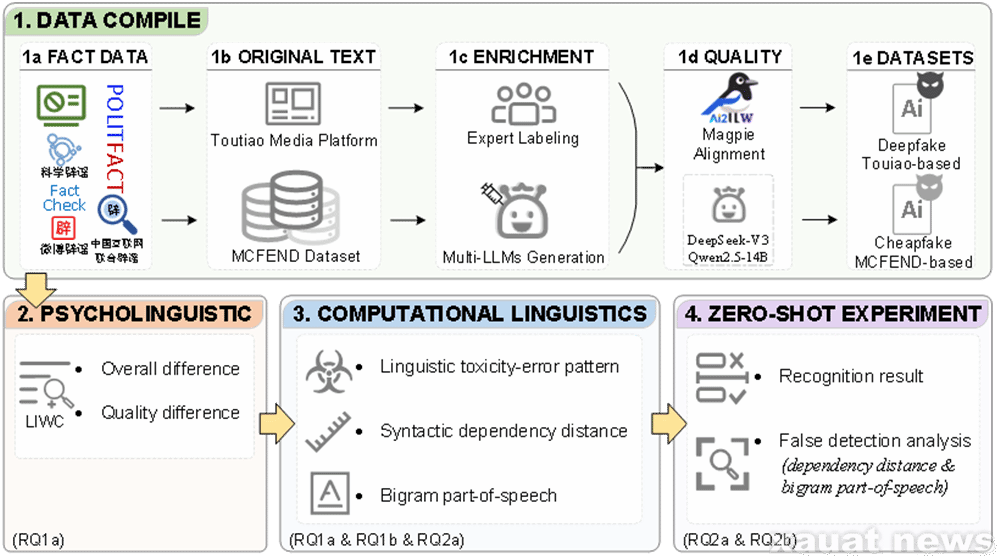

生成式AI技术的普适化为虚假信息的制作、传播和治理提供了新的途径。尽管,LLMs在事实核查过程中会受到幻觉、域外知识缺乏和错误检索引用等阻碍,但基于LLMs的文本特征融合、思维链提示工程、在线检索增强和多智能体协作策略依然被认为是打击AI虚假信息的有效手段。然而,最近的研究表明,当LLM被用于捏造细节和虚假内容洗稿时,AI虚假信息识别任务将对人类和现有基于LLM的检测器颇具挑战。因此,研究团队将注意力重新聚焦到LLM本身,基于心理语言学、计算语言学和零样本提示实验回答以下研究为何融合LLMs语言特征的AI虚假信息识别方法有时会收效甚微以及在零样本提示条件下LLMs能否依靠自身能力理解并区分AI虚假信息等问题。

结合LIWC心理语言学分析、语言毒性和错误、语法依存和二元词性组,以及零样本提示和假阴(阳)性样本分析实验,团队首次发现了AI虚假内容的质量调节效应。即,随着内容质量的增加,AI与人类内容间的创造力差异化、内容标准化和可检测性弱化特征逐渐凸显的变化。实验结果不仅揭示了融合AI虚假语言特征以及利用LLMs参与虚假信息治理的潜在挑战,更呼应了学界有关刺激贫乏理论、范例理论和加工流畅理论的部分观点,从心理加工机制到语言生成特征均展现出新的研究价值。

AI 虚假信息治理已成为政府推进数字安全和网络生态治理的重要任务之一。本研究的发现为学界提供了新的分析框架和实证证据,更为监管机构、平台方及相关管理部门在制定治理策略、优化检测机制和完善风险预警体系等方面提供了科学依据与理论支持。

该研究得到了国家社科基金后期资助项目、教育部人文社科基金规划项目、陕西省社会科学基金年度项目、陕西省重点产业创新链(群)-工业领域项目和陕西省自然科学基础研究计划项目等基金的资助。

论文链接:https://doi.org/10.1038/s41467-025-67145-1

文字:吴静怡、马玉龙(管理学院)

图片:管理学院

编辑:陈莞苏